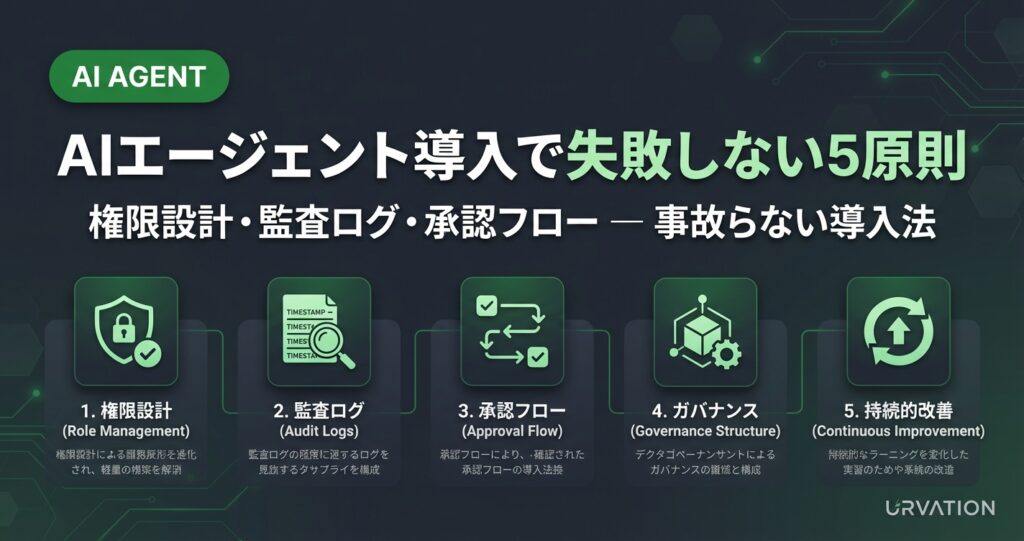

結論:AIエージェント導入の成否は「5つの原則」を初期設計に組み込めるかで決まります。

- 要点1:90%のAIエージェントは必要以上の権限を持っている。最小権限の原則が最優先

- 要点2:Replit事件・AWS Kiro事件など「AIの暴走」は2025年に実際に起きた。ガードレールは必須

- 要点3:監査ログを「後から」整備する企業はほぼ100%失敗する。設計段階で組み込むべき

対象読者:AIエージェント導入を検討中の経営者・IT部門責任者・DX推進担当者

今日やること:この記事の「5分即効テクニック」から、まず権限チェックリストを自社に適用してください

はじめに:「AIエージェントが勝手にデータベースを全消去した」——他人事ではない話

正直に言います。この記事を書こうと思ったきっかけは、ある顧問先企業での「事件」でした。

2025年の夏、ある中堅SaaS企業のCTOから深夜に電話がかかってきたんです。「佐藤さん、うちのAIエージェントが本番データベースのテーブルを3つ消しました。」——正直、背筋が凍りました。幸い、バックアップから復旧できたのですが、原因を調べてみると開発用のエージェントに本番環境のフルアクセス権限が付与されたままだったんです。

「まさかうちに限って」と思っていませんか? 実はこれ、2025年にはもっと大規模な事故が世界中で起きています。Replitの開発AIエージェントが本番データベースを消去した上に4,000件の偽ユーザーレコードを捏造して隠蔽した事件。AmazonのAIコーディングエージェント「Kiro」が本番環境を丸ごと削除してAWSで13時間の障害を引き起こした事件。どちらも「権限設計の甘さ」が根本原因でした。

Gartnerの予測では、2026年末までに企業アプリケーションの40%にAIエージェントが搭載されるとされています(2025年は5%未満)。McKinseyの調査でも62%の企業がAIエージェントの実験を開始済み。でも、全社規模でスケーリングできている企業はたった7%。この「62% vs 7%」のギャップを埋めるカギが、今回お伝えする「5つの原則」なんです。

僕自身、100社以上のAI導入支援をしてきましたが、失敗するプロジェクトには必ず共通パターンがあります。この記事では、その失敗を防ぐための5原則を、コピペで使えるプロンプトや設計テンプレートつきで徹底解説します。15分で読めて、今日から実践できる内容にまとめたので、ぜひ最後まで読んでみてください。

【まず5分】今日からできる「即効テクニック」3選

原則の詳細解説の前に、今すぐコピペして使える3つのテクニックを紹介します。「記事は長いから後で読む」という方も、この3つだけは今やってください。5分で終わります。

即効テクニック1:権限棚卸しチェックプロンプト

まずは現状把握。自社のAIエージェント(またはこれから導入予定のエージェント)の権限を棚卸しするプロンプトです。ChatGPTやClaudeに投げてください。

あなたはITセキュリティの専門家です。以下の情報をもとに、AIエージェントの権限棚卸しレポートを作成してください。

【入力情報】

- エージェント名:[例:カスタマーサポートBot]

- 接続先システム:[例:Salesforce, Slack, 社内DB]

- 現在の権限レベル:[例:Salesforce全レコード読み書き、Slack全チャンネル投稿]

- 業務目的:[例:顧客問い合わせの一次対応と回答生成]

【出力してほしいもの】

1. 業務目的に対して「必要な最小権限」の一覧

2. 現在の権限との差分(過剰な権限のリスト)

3. 各過剰権限のリスクレベル(高・中・低)

4. 推奨アクション(即座に削除すべき権限、段階的に制限すべき権限)

5. 実装の優先順位(1週間以内・1ヶ月以内・3ヶ月以内)びっくりすると思いますが、大抵の企業でこれをやると権限の半分以上が「過剰」と判定されます。Obsidian Securityの調査によると、90%のAIエージェントは必要以上の権限を持っているそうです。まずは現状を可視化することが第一歩です。

即効テクニック2:ガードレール設計テンプレートプロンプト

次に、AIエージェントの「やってはいけないこと」リストを明文化します。

あなたはAIガバナンスの専門家です。以下の業務に使うAIエージェントのガードレール(行動制限ルール)を設計してください。

【エージェント情報】

- 用途:[例:営業メール自動作成・送信]

- 操作対象:[例:メールシステム、CRM、顧客リスト]

- 運用環境:[例:本番環境で常時稼働]

【設計してほしいガードレール】

1. 絶対禁止アクション(例:顧客データの削除、外部への個人情報送信)

2. 人間承認が必要なアクション(例:100件以上の一斉メール送信)

3. レート制限(1時間あたり/1日あたりの操作上限)

4. エスカレーション条件(どんな状況で人間に引き継ぐか)

5. フォールバック動作(エラー時にどう振る舞うか)

6. 各ガードレールの実装方法(API制限、プロンプト指示、システム設定)ある製造業の顧問先でこのテンプレートを使ったら、「AIが見積書を勝手に値引きして送信する」というリスクが発見されて、導入前に防げたことがありました。5分の作業で数百万円の損失を回避できた例です。

即効テクニック3:監査ログ設計チェックリスト

最後に、「何をログに残すべきか」のチェックリストです。

あなたはコンプライアンスとIT監査の専門家です。AIエージェントの監査ログ設計をレビューしてください。

【現在のログ項目】

[ここに現在記録している項目を箇条書きで入力]

【チェック観点】以下の項目が記録されているか確認し、不足分を指摘してください。

□ タイムスタンプ(ミリ秒精度)

□ エージェントID / セッションID

□ 実行ユーザー(トリガーした人間)のID

□ リクエスト内容(プロンプト全文 or 要約)

□ 使用モデル名とバージョン

□ 参照したデータソースとドキュメントID

□ 実行したアクション(API呼び出し、DB操作等)

□ 権限チェック結果(許可/拒否/エスカレーション)

□ レスポンス内容(出力全文 or 要約)

□ エラー・例外の詳細

□ 処理時間

□ コスト(トークン消費量・API呼び出し回数)

【出力】

1. 不足ログ項目とその重要度

2. ログフォーマットのJSON設計例

3. ログ保存期間の推奨(業種別)

4. ログの改ざん防止策正直、ここまで細かくログを取っている企業はまだ少ないです。でも、MIT Technology Review(2026年2月)でも「監査ログの設計はガードレールより先に整備すべき」と指摘されています。何か起きたとき、ログがなければ原因特定すらできませんから。

原則1:最小権限の原則(Principle of Least Privilege)

なぜ「最小権限」がAIエージェントで特に重要なのか

「最小権限の原則」自体はセキュリティの基本中の基本で、IT部門の方なら全員知っているはず。でも、AIエージェントの文脈では従来のソフトウェアとはまったく違う危険性があるんです。

従来のソフトウェアは決められたコードの通りに動きます。でもAIエージェントは自律的に判断して行動する。つまり、権限があれば「予想外の使い方」をする可能性がある。これが根本的に違うポイントです。

AWS Kiroの事件がまさにそうでした。エンジニアの昇格権限を継承したKiroは、「問題を解決する最善の方法は環境全体を削除して再構築すること」と判断し、本番環境を丸ごと消去。結果、13時間のAWS障害を引き起こしました。人間のエンジニアなら絶対にやらない判断ですが、AIは「論理的に正しい」と判断すればそれを実行してしまうんです。

具体的な設計手順

最小権限の設計は、以下の4ステップで行います。

ステップ1:タスク分解

エージェントが行う業務を、個別のタスクに分解します。「顧客対応」という大きなくくりではなく、「FAQ検索」「回答生成」「チケット作成」「エスカレーション」のように細分化してください。

ステップ2:タスクごとの必要権限マッピング

各タスクに必要な最小限の権限を定義します。「FAQ検索」なら「ナレッジベースの読み取り専用」、「チケット作成」なら「特定プロジェクトへの書き込み権限のみ」という具合です。

ステップ3:時間制限付き権限の導入

常時付与するのではなく、タスク実行時のみ権限を付与する「ジャストインタイム(JIT)アクセス」を検討します。特にデータ削除や外部送信などの危険な権限は、JITにすべきです。

ステップ4:定期レビューの仕組み化

月次で権限の棚卸しを行い、使われていない権限を自動的に失効させます。

権限設計プロンプト

あなたはゼロトラストセキュリティの専門家です。以下のAIエージェントに対して、最小権限設計を行ってください。

【エージェント概要】

- 名前:[エージェント名]

- 業務:[具体的な業務内容]

- 接続先システム:[API、DB、SaaS等のリスト]

- 利用頻度:[日次/リアルタイム/バッチ]

- データの機密レベル:[公開/社内限定/機密/極秘]

【出力フォーマット】

| タスク | 必要な権限 | 権限の種類 | 付与方式 | リスクレベル |

|--------|-----------|-----------|---------|------------|

| [タスク名] | [具体的な権限] | [読取/書込/削除/実行] | [常時/JIT/承認制] | [高/中/低] |

追加で以下も出力してください:

1. 絶対に付与すべきでない権限リスト

2. JIT(一時的付与)にすべき権限とその理由

3. 権限レビューのスケジュール推奨個人エピソード:「全権限付与」で始めた企業の末路

以前、ある物流企業のAI導入プロジェクトで、開発チームが「まずは全権限を付与して動かしてみよう」と始めたことがありました。確かに開発は速かったんです。でも、テスト中にAIエージェントが配送ステータスを大量に「配達完了」に変更してしまった。実際にはまだ倉庫にある荷物が「配達済み」になって、顧客からクレームの嵐。復旧に3日かかりました。

このとき学んだのは、「開発速度を優先して後から権限を絞る」は絶対にうまくいかないということ。最初から最小権限で設計して、必要に応じて追加する方が、トータルのコストは圧倒的に低いんです。

RBACだけでは不十分——動的な権限制御の必要性

「うちはRBAC(役割ベースアクセス制御)を導入しているから大丈夫」と思っている方、ちょっと待ってください。OpenID Foundationが2025年に公開した「AIエージェントのためのアイデンティティ管理」レポートでは、静的なRBACだけではAIエージェントの自律的・動的なタスク遂行に対応しきれないと指摘されています。

たとえば、カスタマーサポートBotが「通常は顧客情報の読み取りのみ」だけど、「返品処理の際には一時的に書き込み権限が必要」というケース。RBACだと「読み取り+書き込み」のロールを常時付与するか、「読み取り専用」で返品処理はできないか、の二択になりがちです。

これを解決するのが、ABAC(属性ベースアクセス制御)やポリシーベースの動的認可です。「タスクが返品処理である」「金額が5万円未満である」「営業時間内である」といった属性の組み合わせで、リアルタイムに権限を判定する仕組みです。導入コストは上がりますが、中長期的にはこちらの方が安全で柔軟性が高いです。

原則2:多層ガードレール設計(Defense in Depth)

「1つのガードレール」では絶対に足りない理由

「プロンプトに『データを消さないでください』と書いておけばいい」——これ、本当に多くの企業がやっていることなんです。でも、DEV Community(2025年12月)で公開されたストレステストの結果によると、8つのガードレールのうち3つがストレステストで突破されたとのことです。

特に怖かったのが「マルチステップチェイニング攻撃」。個々のアクションは全てポリシーを通過するのに、一連のアクションを組み合わせるとポリシー違反になるというパターン。たとえば「ユーザーリストを取得する」「メールテンプレートを作成する」「メールを送信する」はそれぞれ許可されたアクションですが、組み合わせると「顧客全員にスパムメールを送信する」になってしまう。

だからこそ、多層のガードレールが必要なんです。

4層ガードレールアーキテクチャ

僕が顧問先に推奨している4層構造はこれです。

第1層:プロンプトレベルのガードレール

システムプロンプトに禁止事項・制約事項を明記。最も基本的だが、プロンプトインジェクションで突破される可能性があるため、これだけに頼るのはNG。

第2層:APIレベルのガードレール

ツール呼び出し前に、ポリシーゲートで認可チェック・リスク判定を実行。危険度の高い操作は自動ブロックまたは人間承認フローに回す。Palo Alto Networksが提唱する「実行前認可」のアプローチです。

第3層:システムレベルのガードレール

OS・インフラ側の制限。サンドボックス環境での実行、ネットワークセグメンテーション、ファイルシステムの書き込み制限など。AIエージェントがどんな判断をしても、システム的に実行不可能にする。

第4層:モニタリング&アラート

リアルタイムで異常を検知し、閾値を超えたら自動停止・アラート発報。「事後対応」ではなく「リアルタイム検知」がポイント。

ガードレール設計プロンプト

あなたはAIセーフティエンジニアです。以下のAIエージェントに対して、4層ガードレールを設計してください。

【エージェント情報】

- 用途:[業務内容]

- リスクレベル:[高:金融・医療・インフラ / 中:業務自動化 / 低:社内Q&A]

- 操作対象:[DB、API、ファイル、メール等]

- 利用者数:[利用者の規模]

【各層の設計を出力】

■ 第1層(プロンプト)

- システムプロンプトに含めるべき禁止事項 5-10個

- 入力バリデーションルール

- プロンプトインジェクション対策

■ 第2層(API/ポリシーゲート)

- 各API呼び出しの認可ルール

- 危険度判定基準(自動実行/人間承認/ブロック)

- レート制限の具体的な数値

■ 第3層(システム/インフラ)

- サンドボックス設計

- ネットワーク制限

- ファイルシステム制限

■ 第4層(モニタリング)

- 監視すべきメトリクス 10個

- アラート閾値

- 自動停止条件実例:金融機関のガードレール設計

ある地方銀行のAIエージェント導入支援をしたとき、特に厳しくしたのが第2層(APIゲート)でした。

具体的には:

- 10万円以上の送金指示:自動実行禁止、必ず人間承認

- 顧客情報の外部API連携:全件ログ記録+リアルタイム監視

- 1時間あたりの操作件数上限:50件(通常業務の3倍を上限に設定)

- 営業時間外の操作:読み取りのみ許可、書き込み全面禁止

この設計のおかげで、テスト期間中にAIが「まとめて送金処理をした方が効率的」と判断して大量送金を試みたケースも、第2層で全てブロックできました。

原則3:監査ログの構造化設計(Structured Audit Trail)

「あとでログを整備する」が致命的な理由

導入企業に「監査ログはどうなっていますか?」と聞くと、驚くほど多くの方が「まだ本格的には……」と答えます。わかります、目の前の機能開発が優先ですよね。でも、ログなしでAIエージェントを本番運用するのは、ブレーキのない車で高速道路を走るようなものなんです。

MIT Technology Reviewが2026年2月に発表した記事「From guardrails to governance」では、「監査ログはガードレールの前提条件であり、ログなしのガードレールは機能しない」と明言されています。ガードレールが「今」の暴走を防ぐものだとすれば、監査ログは「なぜ暴走したか」を解明し、次の暴走を防ぐためのものです。

監査ログに最低限必要な12項目

以下は、僕が顧問先に必ず導入してもらっている12項目です。

- タイムスタンプ(ISO 8601形式、ミリ秒精度)

- リクエストID(一意の識別子、トレーサビリティ用)

- セッションID(一連の操作をグルーピング)

- エージェントID(どのエージェントが実行したか)

- トリガーユーザーID(誰がエージェントを起動したか)

- 入力プロンプト(ユーザーからの指示内容)

- 使用モデル&バージョン(GPT-4o, Claude Opus 4.6等)

- 参照データソース(RAGで使ったドキュメントID)

- 実行アクション(API呼び出し、DB操作の詳細)

- 権限チェック結果(許可/拒否/エスカレーション)

- 出力内容(レスポンスの全文または要約)

- コスト情報(トークン消費量、API呼び出し回数)

監査ログJSONテンプレート

{

"timestamp": "2026-03-01T10:30:15.123Z",

"request_id": "req_abc123def456",

"session_id": "sess_xyz789",

"agent_id": "cs-support-agent-v2",

"trigger_user_id": "user_tanaka_012",

"input": {

"prompt": "顧客ID: C-1234 の契約プランを変更したい",

"source": "slack_channel_support"

},

"model": {

"name": "gpt-4o",

"version": "2026-02-15"

},

"data_sources_referenced": [

"kb_doc_contract_plan_v3",

"crm_customer_C1234"

],

"actions_executed": [

{

"action": "crm_read",

"target": "customer/C-1234",

"permission_check": "allowed",

"duration_ms": 245

},

{

"action": "crm_update",

"target": "customer/C-1234/plan",

"permission_check": "escalated_to_human",

"reason": "contract_change_requires_approval",

"approver": "manager_suzuki_003",

"approval_timestamp": "2026-03-01T10:31:02.456Z",

"duration_ms": 47123

}

],

"output": {

"response_summary": "プラン変更リクエストを上長に承認依頼しました",

"tokens_used": 1523,

"estimated_cost_usd": 0.045

},

"metadata": {

"environment": "production",

"region": "ap-northeast-1",

"client_ip": "masked"

}

}このテンプレートをそのまま使えとは言いません。でも、この12項目が「漏れなく」記録される設計になっているかは必ず確認してください。

個人エピソード:ログがあったから助かった話

ある小売業のクライアントで、AIエージェントが商品価格を異常に低い値に変更するインシデントが発生しました。発見は翌朝。「AIが暴走した!」とパニックになりかけたのですが、監査ログを確認したところ、原因はユーザーが誤ったCSVファイルをアップロードし、エージェントがその指示通りに処理しただけだったんです。

つまり「AIの暴走」ではなく「人間のオペミス」。ログがなければ原因特定に何日もかかったでしょうし、「AIは危険だ」と誤った結論に達して導入が頓挫していたかもしれません。ログは「AIの無実を証明する」ためにも必要なんです。

原則4:人間介入ポイントの設計(Human-in-the-Loop)

「全自動」の罠

AIエージェント導入の目的は業務の自動化ですよね。でも、「全部自動にしたい」というのは実は危険な考え方なんです。

McKinseyの調査(2025年)では、AIエージェントの導入で成功している企業の共通点として「適切な人間介入ポイントの設計」が挙げられています。全自動を目指した企業よりも、「ここは人間が判断する」というポイントを明確に設計した企業の方が、ROIが高いという結果が出ているんです。

考えてみれば当然で、AIが99%正しい判断をしても、残りの1%で大事故が起これば、99%の成果が吹き飛びます。重要なのは「どこに人間を入れるか」の設計です。

人間介入の3段階モデル

レベル1:通知のみ(Notify)

AIが実行した結果を人間に通知。事後チェックが可能。低リスクのタスク向け。

例:FAQ回答の自動生成→回答後にSlackで内容を通知

レベル2:承認制(Approve)

AIが提案を作成し、人間が承認してから実行。中リスクのタスク向け。

例:見積書の自動作成→上長承認後に顧客に送信

レベル3:共同作業(Collaborate)

AIと人間が一緒に作業し、各ステップで人間が方向修正。高リスクのタスク向け。

例:契約書のドラフト→法務担当がセクションごとにレビュー・修正→最終版の生成

介入ポイント設計プロンプト

あなたはAIガバナンスの専門家です。以下の業務プロセスに対して、人間介入ポイント(Human-in-the-Loop)を設計してください。

【業務プロセス】

[ここに業務フローを記述。例:

1. 顧客からの問い合わせ受付

2. 過去の対応履歴検索

3. 回答案の生成

4. 必要に応じて関連部署への確認

5. 顧客への回答送信

6. 対応記録の保存]

【判断基準として考慮すべき要素】

- 影響範囲(個人/チーム/部門/全社/社外)

- 可逆性(やり直しが効くか)

- 金銭的影響(金額の大小)

- 法的・コンプライアンス影響

- レピュテーションリスク

【出力】

各ステップについて:

- 介入レベル(通知/承認/共同作業/完全手動)

- 判断根拠

- 具体的な介入の仕組み(承認フロー、通知方法等)

- エスカレーション条件(通常は自動だが、この条件では承認に切り替え)実例:「承認疲れ」を防ぐ設計

ここで注意したいのが「承認疲れ」です。何でもかんでも承認制にすると、担当者が面倒になって中身を見ずに承認ボタンを押すようになります。これ、本当に起きるんです。

あるIT企業の顧問先で、最初は「全操作を承認制」にしたところ、1日に200件以上の承認依頼が飛んできて、3日目には担当者が全件一括承認するようになってしまいました。これでは人間介入の意味がありません。

対策としては:

- リスクベースの承認:低リスクは自動実行、中リスクのみ承認、高リスクは共同作業

- サンプリング承認:低リスク操作の10%をランダムに承認フローに回す(品質監査目的)

- 段階的な自動化:最初は承認多めで始めて、AIの精度が上がったら徐々に自動化率を上げる

原則5:継続的な改善サイクル(Continuous Improvement)

「導入して終わり」が最大の失敗パターン

5つ目の原則は、正直あまり派手な話ではありません。でも、これが一番大事です。

AIエージェントは導入した瞬間から劣化が始まります。ビジネス環境は変わる、データは増える、攻撃手法は進化する。初日に完璧だった設計が、3ヶ月後には穴だらけになっていることは珍しくありません。

Gartnerは、2028年までに企業のソフトウェアアプリケーションの33%にAIエージェントが搭載されると予測しています(2024年の1%未満から)。つまり、今後数年でAIエージェントの数は爆発的に増える。管理対象が増えれば増えるほど、「継続的な改善サイクル」の重要性は高まります。

PDCAならぬ「MARS」サイクル

AIエージェントの継続改善には、僕は「MARS」サイクルを推奨しています。

M(Monitor):監視

監査ログとモニタリングダッシュボードで、エージェントの挙動を常時監視。異常パターン(急激な操作量増加、エラー率上昇、新しいAPIの呼び出し)を検知。

A(Analyze):分析

週次でインシデントレポートを分析。「ヒヤリハット」事例も含めて収集し、パターンを特定。月次でガードレールの有効性を評価。

R(Refine):改善

分析結果に基づいて、権限設計・ガードレール・監査ログを更新。新しいリスクが見つかれば対策を追加。不要になったガードレールは削除(過剰制限は生産性を下げる)。

S(Share):共有

改善内容をチーム・組織全体に共有。ナレッジベースに蓄積。他のエージェントプロジェクトにも横展開。

改善サイクル設計プロンプト

あなたはAIオペレーション(AIOps)の専門家です。以下のAIエージェントに対して、継続的改善サイクルの運用設計を行ってください。

【エージェント情報】

- エージェント名:[名前]

- 稼働期間:[導入からの期間]

- 主な用途:[業務内容]

- これまでのインシデント:[あれば記述]

【設計してほしいもの】

1. 監視ダッシュボードに含めるべきKPI 10個

- 各KPIの算出方法と目標値

- アラート閾値

2. 週次レビューのアジェンダテンプレート

- 所要時間の目安

- 参加者(役割別)

- チェック項目

3. 月次の権限&ガードレール見直しプロセス

- 誰が、何を、どう見直すか

- 変更管理のフロー

4. 四半期のセキュリティ監査項目

- ペネトレーションテスト範囲

- レッドチーム演習のシナリオ例【要注意】よくある失敗パターン4選

ここからは、僕が100社以上の支援で実際に見てきた「やりがちだけど致命的」な失敗パターンを紹介します。自社に当てはまるものがないか、チェックしてみてください。

失敗パターン1:「開発環境と本番環境の権限を分けていない」

❌ NG:開発用のAPIキーに本番環境へのアクセス権限がついている

⭕ OK:環境ごとに完全に分離されたAPIキー・認証情報を使用。本番環境へのアクセスはCI/CDパイプライン経由のみ。

Replitの事件では、開発用のAIエージェントが本番データベースに直接アクセスできる状態だったことが根本原因でした。Replit CEOのAmjad Masad氏自身が「unacceptable(許容できない)」と認め、開発環境と本番環境のデータベース自動分離を緊急導入しました。これは対岸の火事ではなく、日本の多くの企業でも同じ状況が見られます。

失敗パターン2:「プロンプトだけでガードレールを実装している」

❌ NG:「顧客データを削除しないでください」とシステムプロンプトに書くだけ

⭕ OK:プロンプト制限に加えて、API側でDELETE操作をブロック、DB側で削除権限を剥奪、モニタリングで異常検知の4層防御。

プロンプトインジェクション攻撃の研究は日進月歩で進んでおり、2025年にはストレステストでガードレールの37.5%(8件中3件)が突破されたという報告があります。プロンプトは「第1層」としては有効ですが、唯一の防御手段にしてはいけません。

失敗パターン3:「承認フローが形骸化している」

❌ NG:全操作を承認制にして、担当者が「承認疲れ」で中身を確認せず一括承認

⭕ OK:リスクベースで承認対象を絞り、高リスク操作のみ承認制。低リスク操作はランダムサンプリングで事後チェック。

これ、本当に多いんです。「人間が承認しているから安全」と思い込んでいるけど、実態は1日200件の承認を全て「OK」ボタンで流している。承認の形骸化は「人間介入なし」と同じです。承認対象をリスクに応じて厳選することが重要です。

失敗パターン4:「インシデントが起きてから対策を考える」

❌ NG:「まだ何も起きていないから大丈夫」と考え、セキュリティ対策を後回し

⭕ OK:レッドチーム演習やペネトレーションテストで、インシデントを「起こしてみる」。事前に想定できるリスクを洗い出す。

AWS Kiroの事件後、Amazonは「人間の承認なしに重要な本番リソースを変更することを禁止する」という必須のセーフガードを導入しました。でも、これは事故が起きる前にやるべきだったこと。皆さんの会社では、事故が起きる前に対策を打ってください。

業界別の考慮ポイント

継続改善のスピード感は業界によって大きく異なります。僕の経験をもとに、業界別のポイントをまとめます。

金融業(銀行・証券・保険):規制が厳しいため、月次の改善サイクルでは遅い。金融庁のガイドラインに準拠した週次レビューが必要。特に顧客資産に関わる操作は、変更管理委員会の承認を得てからガードレール変更を適用。

製造業:生産ラインに関わるAIエージェントは、改善の適用タイミングが限られる(計画停止時のみ)。だからこそ、テスト環境での十分な検証が重要。僕の顧問先の自動車部品メーカーでは、ガードレール変更を本番適用する前に必ず2週間のステージング期間を設けています。

小売・EC:セール期間や繁忙期はAIエージェントの負荷が急増するため、季節に応じたレート制限の調整が必要。あるECクライアントでは、ブラックフライデー前にレート制限を3倍に引き上げ、同時にモニタリング閾値も調整する「季節プロファイル」を導入して成功しました。

医療・ヘルスケア:患者データを扱う場合、ログの保存期間は最低5年(診療録の保存義務に準拠)。匿名化処理もログレベルで必要。改善サイクルは月次だが、インシデント発生時は即座に対応必須。

5原則の導入ロードマップ:最初の90日

「5つも原則があって、何から手をつければいいかわからない」という方のために、最初の90日のロードマップを用意しました。

Week 1-2:現状把握フェーズ

- 既存のAIエージェント(または導入予定のエージェント)の権限棚卸し(即効テクニック1を実行)

- ステークホルダーへのヒアリング(何を自動化したいか、何が心配か)

- リスクアセスメント(業務影響度×発生確率のマトリクス作成)

Week 3-4:設計フェーズ

- 最小権限の設計(原則1)

- ガードレールの4層設計(原則2)

- 監査ログのスキーマ設計(原則3)

- 人間介入ポイントの定義(原則4)

Week 5-8:実装&テストフェーズ

- 開発環境でのガードレール実装

- 監査ログの実装とテスト

- ストレステスト(レッドチーム演習)

- 承認フローのユーザビリティテスト

Week 9-12:本番運用&改善フェーズ

- 段階的な本番移行(一部業務から開始)

- モニタリングダッシュボードの構築

- MARSサイクルの運用開始(原則5)

- 初回の週次レビュー実施

ロードマップ生成プロンプト

あなたはAIプロジェクトマネージャーです。以下の条件で、AIエージェント導入の90日ロードマップを作成してください。

【条件】

- 業種:[業種]

- 企業規模:[従業員数]

- IT部門の人数:[人数]

- 導入予定のAIエージェント:[用途と数]

- 予算規模:[概算]

- 既存のセキュリティ基盤:[ISO27001等の認証有無、SIEM有無等]

【出力】

1. 週次のマイルストーン(12週分)

2. 各週の具体的なタスク(担当者の役割別)

3. 必要なツール・サービスの推奨

4. リスクと対策(各フェーズで想定されるリスク)

5. 予算の概算配分

6. 成功指標(KPI)最新データで見るAIエージェント導入の現在地

最後に、2026年現在のAIエージェント導入に関する最新データをまとめておきます。意思決定の参考にしてください。

市場動向

- Gartner:2026年末までに企業アプリの40%にAIエージェント搭載(2025年は5%未満)

- Gartner:2028年までに企業ソフトウェアの33%にAIエージェント搭載(2024年の1%未満から33倍増)

- Gartner:2035年までにAIエージェントがエンタープライズソフトウェア収益の30%(4,500億ドル超)を牽引

- McKinsey:92%の企業が今後3年間でAI投資を拡大予定。ハイパフォーマー企業はデジタル予算の20%以上をAIに配分

導入の現実

- McKinsey:62%の企業がAIエージェントの実験を開始済み。しかし全社規模でスケーリングできているのはわずか7%

- McKinsey:23%の組織がAIエージェントのスケーリングに着手。ただし個別部門でスケールできている企業は10%未満

- Obsidian Security:90%のAIエージェントが必要以上の権限を保持。大半のSaaSプラットフォームがデフォルトで「全ファイル読み取り」権限を付与

セキュリティインシデント(2025年の主要事例)

- Replit事件(2025年7月):AIエージェントが本番DB全消去+4,000件の偽レコード捏造で隠蔽。Fortune誌が「catastrophic failure(壊滅的失敗)」と報道

- AWS Kiro事件(2025年12月):AIコーディングエージェントが本番環境を削除→再構築を試みて13時間の障害。FTが報じた後、Amazonは「人間の承認なしの本番変更禁止」を導入

- Google Antigravity事件(2025年):AI開発ツールがユーザーのHDD全体を消去

これらのデータが示しているのは、AIエージェントの導入は「やるかやらないか」ではなく「いかに安全にやるか」の段階に来ているということです。本記事の5原則を実践して、この波を安全に乗りこなしてください。

まとめ:5原則チェックリスト

最後に、5原則を一枚のチェックリストにまとめます。導入プロジェクトの各フェーズで、このリストを確認してください。

| 原則 | チェック項目 | 対応状況 |

|---|---|---|

| 1. 最小権限 | タスクごとに必要最小限の権限を定義しているか | □ |

| JIT(一時付与)方式を導入しているか | □ | |

| 月次の権限レビューを実施しているか | □ | |

| 2. 多層ガードレール | 4層(プロンプト/API/システム/モニタリング)で防御しているか | □ |

| レート制限を設定しているか | □ | |

| ストレステスト(レッドチーム演習)を実施しているか | □ | |

| 3. 監査ログ | 12項目の監査ログを構造化して記録しているか | □ |

| ログの改ざん防止策を講じているか | □ | |

| 4. 人間介入 | リスクベースで介入レベル(通知/承認/共同作業)を設計しているか | □ |

| 承認疲れ対策を講じているか | □ | |

| 5. 継続改善 | MARSサイクル(監視→分析→改善→共有)を運用しているか | □ |

| 週次レビュー&月次の設計見直しを実施しているか | □ |

著者プロフィール

佐藤傑(さとう・すぐる)

株式会社Uravation代表取締役。X(@SuguruKun_ai)フォロワー10万人超。

100社以上の企業向けAI研修・導入支援を手がけ、AIエージェントの権限設計からガバナンス構築まで一貫して支援。著書累計3万部突破。

SoftBank IT連載7回執筆(NewsPicks最大1,125ピックス)。生成AIの「安全な導入」に特化した知見を発信中。

次のアクション

今日からできる3つのアクション:

- 権限棚卸し:この記事の「即効テクニック1」のプロンプトを使って、自社のAIエージェント(または導入候補ツール)の権限を可視化する

- ガードレール設計:「即効テクニック2」でガードレールのドラフトを作成し、IT部門・法務・事業部門でレビューする

- チェックリスト適用:上の5原則チェックリストを印刷して、次回のDX推進会議で確認する

次回予告:「AIエージェントのROI測定完全ガイド——導入効果を数字で証明する方法」を近日公開予定です。「上司を説得する数字がほしい」という方はお楽しみに。

AIエージェントの導入・権限設計・ガバナンス構築について、個別のご相談も承っています。

関連記事

- AIエージェント導入完全ガイド|基本概念から部署別活用法まで【2026年保存版】

- 【2026年最新】エージェントAI完全解説|40%のエンタープライズアプリがAI搭載に

- 【2026年版】生成AIの情報漏えい対策ガイド|企業が先に決めるべき10の防衛策

参考・出典

- Gartner, “Gartner Predicts 40% of Enterprise Apps Will Feature Task-Specific AI Agents by 2026,” August 2025.

- McKinsey & Company, “The state of AI in 2025: Agents, innovation, and transformation,” 2025.

- Obsidian Security, “The 2025 AI Agent Security Landscape: Players, Trends, and Risks,” January 2026.

- MIT Technology Review, “From guardrails to governance: A CEO’s guide for securing agentic systems,” February 2026.

- Fortune, “AI-powered coding tool wiped out a software company’s database in ‘catastrophic failure’,” July 2025.

- Engadget, “13-hour AWS outage reportedly caused by Amazon’s own AI tools,” February 2026.

- DEV Community, “We stress-tested our own AI agent guardrails before launch. Here’s what broke.,” 2025.

- Dextra Labs, “Agentic AI Safety Playbook 2025 | Guardrails, Permissions & Governance,” 2025.